Nvidia lleva invirtiendo una gran cantidad de dinero en los últimos años en crear arquitecturas energéticamente eficientes y que permitan buenas subidas de frecuencias. Pero todo esto sería más complicado si las fundiciones de chips como Samsung o TSMC no aumentaran el nivel de integración, permitiendo la inclusión de más transistores en el mismo espacio.

Eso se realiza con la reducción del tamaño de estos transistores, y tras unos cuantos años con Nvidia y AMD fabricando los tansistores a 28 nm, han llegado las primeras tarjetas gráfica que, en el caso de Nvidia, los transistores tienen un tamaño de 16 nm. Esto permite más potencia y menos consumo, gracias a la nueva arquitectura Pascal, sucesora de la Maxwell (GT 750 y GTX 750 Ti) y Maxwell 2 (serie 900 y 900M).

Arquitectura Pascal

Nvidia ha llevado la delantera claramente en el apartado del consumo a AMD desde hace más de dos años. Lo que no han podido conseguir antes a base de reducir el tamaño de los transistores de los chips, Nvidia lo consiguió con la arquitectura Maxwell. Se presentó a principios de 2014, y se revisó para el lanzamiento de las tarjetas de la serie 900, que llegaron en septiembre del mismo año.

Ahora le han dado una vuelta de tuerca más en la arquitectura Pascal, que si bien no hay grandes cambios con respecto a Maxwell, sí que son cuanto menos interesantes e importantes. Sobre todo centrados en añadir ancho de banda de la memoria y la gestión de los hilos de ejecución.

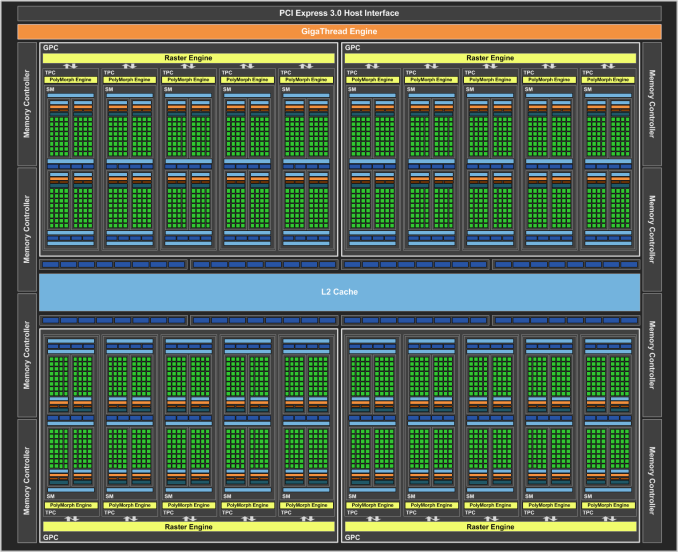

Empezando por el diagrama de bloques, la arquitectura Pascal usada en la GTX 1080 tiene la estructura clásica que lleva usando Nvidia desde las tarjetas Fermi. Al máximo nivel, en Pascal se encuentran los clústeres de procesamiento gráfico (GPC, Graphics Processing Cluster), que se componen a su vez de clústeres de procesamiento de texturas (TPC, Texture Processing Cluster), y estos a su vez incluyen un multiprocesador de flujos de datos (SM, Streaming Mutiprocessor) y un motor de polimorfismo (PolyMorph Engine). Los chips incluyen varios controladores de memoria.

Un repaso a los fundamentos de generación de gráficos

Hablar de arquitecturas cuando en realidad no se tiene idea de lo que ocurre entre bastidores en el PC cuando se están mostrando gráficos 3D por pantalla puede ser cuanto menos confuso. A alto nivel, cuando se mueve un personaje por el mundo creado por los diseñadores de juegos, esos movimientos se traducen en llamadas a la librería gráfica de turno (DirectX, Vulkan, OpenGL, Metal) según lo que haya estipulado el programador.

Esas llamadas son introducidas en un búfer, y cada cierto tiempo se envían a la GPU para procesamiento. Los gráficos que se muestran por pantalla están creadas por millones de triángulos, que es el elemento básico en la generación de gráficos por computadora. La GPU tendrá que coger las instrucciones, creando los triángulos relacionados a generar, y crear diversas cargas de trabajo que serán ejecutadas por los GPC.

| Comparativa gráficas GeForce | ||||

|---|---|---|---|---|

| Característica | GeForce GTX 1080 | GeForce GTX 1070 | GeForce GTX 980 | GeForce GTX 970 |

| Chip | GP104 | GP104 | GM204 | GM204 |

| Sombreadores | 2560 | 1920 | 2048 | 1664 |

| Uds textura | 160 | 120 | 128 | 104 |

| Uds renderizado | 64 | 64 | 64 | 56 |

| Velocidad | 1607MHz | 1506MHz | 1127MHz | 1050MHz |

| Turbo | 1733MHz | 1683MHz | 1216MHz | 1178MHz |

| Memoria | GDDR5X | GDDR5 | GDDR5 | GDDR5 |

| Tamaño | 8GB | 8GB | 4GB | 4GB |

| Bus memoria | 256bits | 256bits | 256bits | 256bits |

| Frec memoria | 10GHz | 8GHz | 7,012GHz | 7GHz |

| Ancho de banda | 320GB/s | 256GB/s | 224GB/s | 224GB/s |

| Consumo | 180W | 150W | 165W | 145W |

| TFLOPS | 8.6 | 6.75 | 4,6 | 3.5 |

Arquitectura Pascal

El chip GP104 incluye cuatro GPC de cinco TPC cada una, y ocho controladores de memoria. Cada SM incluye cuatro grupos de núcleos que son los que tendrán que recibir diversos datos y ejecutarlos. A esos triángulos habrá que aplicarles la teselación (división en partes más pequeñas) para así poderles aplicar mapas de desplazamiento que son los que crean la sensación de profundidad de las texturas.

El motor de polimorfismo se encarga de capturar la información de vértices de los triángulos, así como de dividirlos en polígonos más pequeños para su posterior teselación, lo que aumenta exponencialmente el número de polígonos de un fotograma. Los motores de polimorfismo incluyen su propia teseladora y capturadora de vértices. Otras funciones que realiza este motor es el de calcular sombras mediante los SM, y de ahí viene el nombre de los sombreadores (shaders) que Nvidia los llama núcleos CUDA.

El SM es un multiprocesador paralelo, y en el GP104 cada SM incluye 128 núcleos CUDA, con 256 KB de registros y 96 KB de memoria compartida, así como 48 KB de caché L1, más ocho unidades de texturas.

El SM se encarga de gestionar las urdimbres (warp, también llamados manojos) o grupos de 32 hilos mediante un gestor de urdimbres, que son enviadas a los núcleos CUDA por la SM para que recopilen los datos necesarios a través de unas unidades especiales llamadas planificadores de hilos. En un momento dado puede haber varias urdimbres en proceso de ejecución, y en función del tiempo que lleven ejecutarse, puede irse alternando la ejecución de unas y otras mientras, por ejemplo, se recopila toda la información necesaria para completar la instrucción.

Para el motor de polimorfismo es una unidad de cálculo, que una vez generado un triángulo también tiene que calcular con las SM cosas como la transformación del punto de vista o correcciones de perspectiva. Una vez tienen todos los datos, la urdimbre se ejecuta.

Las SM también incluyen registros donde se guarda información a usar por las instrucciones que ejecutan los núcleos CUDA, unidades de funciones especiales (SFU) para la ejecución de funciones trascendentes (seno, coseno, logaritmo, etc.) y unidades de carga y almacenaje (LD/ST). Suele verse como óptimo el que, debido a que la información se almacena en registros comunes, todos los sombreadores ejecuten la misma instrucción al mismo tiempo.

Una vez que termina el procesamiento de generación de polígonos por la TPC, la GPC se encarga de pasar la información al motor de rasterizado, segmentándolo para crear cargas de trabajo más pequeñas. Esto significa que se transforman en píxeles concretos para que puedan ser fácilmente manipulados, teniendo en cuenta la posición espacial del triángulo (que previamente ya se ha corregido al calcular su posición global en las SM), y eliminando la información que no afecta al renderizado del triángulo.

Todos los cálculos se realizan nuevamente a través de una GPC que tenga asignada la ROP, pero en este caso se tratan de hilos de generación de píxeles en vez de hilos de generación de vértices. Es una doble función que tienen los SM. También se ejecutan en grupos de 32 píxeles, u ocho grupos de 2 x 2 píxeles

Estos píxeles son enviados a las unidades de renderizado (ROP, Raster Operations Pipeline), de las que el GP104 incluye ocho en cada controlador de memoria (un total de 64 ROP). Se encargan del posprocesamiento de los píxeles generados por las GPC, la aplicación del antiescalonamiento (antialiasing), la fusión de píxeles, y las comprobaciones de profundidad. Una vez terminado todo el procesamiento, se ponen en el búfer de vídeo para mostrarse por pantalla.

Los sombreadores son programados con un lenguaje de sombreado, por ejemplo el de OpenGL o DirectX, pero también hay otros como el usado por Sony en la PlayStation o el de Metal (iOS). Suelen tener una sintaxis similar a C.

Las novedades de Pascal

Nvidia ha ido realizando pequeñas grandes modificaciones de la microarquitectura de sus tarjetas gráficas desde la presentación de Fermi, y en la generación Pascal la más importante ha sido la inclusión de una compresión de memoria. Esto permite que, al recuperar información de memoria, se tengan que mover menos bytes y por tanto se tarde menos en hacerlo y se aumente el ancho de banda efectivo de la tarjeta gráfica.

En Pascal se deja menos zonas sin comprimir. En la siguiente imagen, las zonas en magenta son las que son susceptibles de ser comprimidas, correspondiéndose la de la derecha de todo a la compresión en Pascal. Nvidia asegura que esto otorga un 70 % más de memoria efectiva que Maxwell.

La computación asíncrona es otro aspecto tocado por la compañía, que afecta a cosas como el posprocesamiento de los fotogramas renderizados, la generación de una urdimbre para RV (urdimbre temporal) o el procesamiento de audio o físicas de un juego. En estos casos puede ocurrir que no se puedan ejecutar las urdimbres completas (32 hilos) procedentes de una misma tarea, y se puedan enlazar dos o más tareas en una única urdimbre.

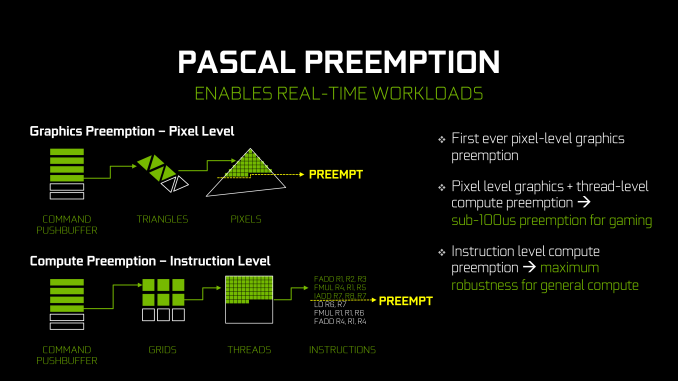

De esta forma se pueden aprovechar potenciales tiempos de inactividad de la tarjeta gráfica. En este apartado también entra la multitarea apropiativa, que se encarga de asignar tiempos determinados de ejecución al nivel de píxel, y no solo a nivel de hilo como hasta ahora. Esto permite que, en un momento dado, se pueda detener la generación de un píxel, guardando el contexto, para empezar a ejecutar una tarea más prioritaria, y posteriormente recuperar el contexto y continuar la generación de píxeles.

De otra forma, en el modelo de apropiación a nivel de hilo, se tendría que terminar la ejecución de las tareas sobre toda la urdimbre antes de poder intercalar la ejecución de una tarea más prioritaria. Por tanto, es una característica introducida con la realidad virtual en mente, ya que los márgenes de tiempo que se manejan para la generación de los fotogramas son menores. Nvidia también ha añadido la apropiación a nivel de hilo para las cargas de trabajo de computación no directamente relacionadas con la generación de gráficos.

Fijaros que, según lo explicado anteriormente, ahora encontraréis sentido al primer gráfico de los dos incluidos en la siguiente transparencia. La primera figura es el búfer de instrucciones de donde el GPC decide qué triángulos debe generar, y que posteriormente gracias al motor de rasterizado va creando los píxeles concretos, con su información de luz y color, que conforman los triángulos. En ese punto de generación de píxeles es donde la computación asíncrona puede ahora detener la generación para ganar rapidez en tareas prioritarias.

La multiproyección simultánea (SMP) es un nuevo bloque situado en el motor de polimorfismo, y se encarga de corregir la perspectiva en varias orientaciones de una imagen desde un mismo punto de vista. En el entorno de la realidad virtual, para cada una de las lentes (proyecciones) se generaría desde un único punto de vista las dos proyecciones de las lentes.

Pero también permite corregir los problemas de representación en configuraciones multimonitor, que no tienen en cuenta el ángulo que forma entre sí cada uno de los monitores (varias proyecciones desde un mismo punto de vista). También corrige en pantallas curvas, o incluso en potenciales pantallas esféricas y realidad aumentada.

Lo importante del asunto es que de esta forma la mayor parte del trabajo para ambos fotogramas se realiza de manera común, descargando de trabajo a la tarjeta gráfica. Se puede realizar utilizando una de dieciséis posibles proyecciones preconfiguradas en Pascal.

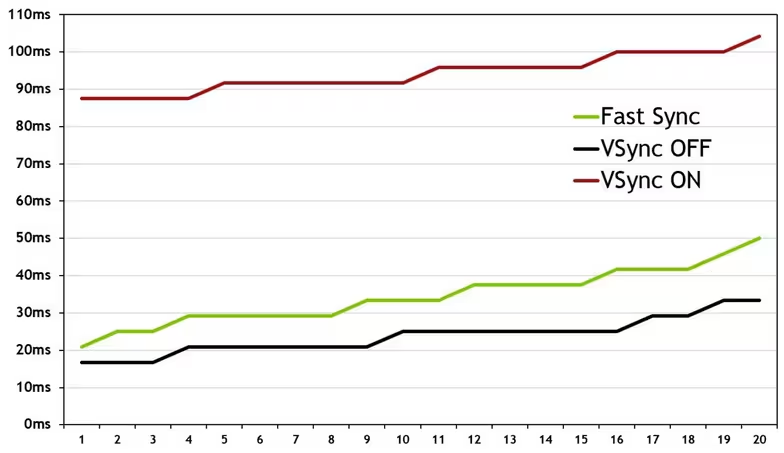

También hay una nueva característica denominada Fast Sync, con la que Nvidia quiere dar una solución a los problemas relacionados con la sincronización vertical (V-Sync). Al activar V-Sync se produce un aumento del retardo de entrada, lo que puede producir una sensación de que los juegos tardan más en reaccionar.

Al activar Fast Sync, se realiza un búfer adicional de los fotogramas recién generados para poder enviarlos nuevamente, eliminando procesamiento adicional y disminuyendo el retardo y el corte de fotogramas o tearing. Esta característica se puede activar en el panel de control de Nvidia.

Inspección visual

Nvidia ha mantenido sus tarjetas de referencia con un aspecto muy similar en los últimos años, y esta GTX 1080 incluye una refrigeración por cámara de vapor. Esto quiere decir que en el interior del disipador se encuentra una pequeña cantidad de agua purificada, que en el proceso de evaporación mueve el calor hacia la parte superior, momento en el cual intercambia el calor, se condensa y vuelve a caer. Por tanto utiliza el mismo principio de los caloductos o heat pipes de alternancia entre estado líquido y gaseoso, pero de una forma bastante más eficiente. Para ayudar, la tarjeta también incluye una placa trasera que mejora la dispersión del calor.

La carcasa exterior ha sido ligeramente rediseñada con unas formas más angulares, que no desagradan, y al menos a mi me gusta más que el diseño simple y anodino de las tarjetas de referencia de AMD. En la parte trasera se incluyen tres conectores DisplayPort 1.4, un HDMI 2.0b y un DL-DVI. Las conexiones permiten mover pantallas 4K a 144 Hz, por lo que ahora solo hace falta que empiecen a llegar al mercado este tipo de monitores para que los jugones puedan sacarle provecho con un SLI de GTX 1080.

La tarjeta de referencia incluye un único conector PCIe de ocho pines, lo que dota a las tarjeta de un consumo máximo de 225 W. Es un escenario que se conseguirá al subir frecuencias, pero que por otra parte el sistema de refrigeración por cámara de vapor solo permitirá en ciertas condiciones alcanzar los 2100 MHz de turbo que Nvidia indicó en la presentación de la GTX 1080.

Equipo de pruebas

Para la realización de las pruebas de rendimiento he utilizado diversos equipos debido a que quería comprobar a la vez que analizaba la tarjeta gráfica algunas cosas adicionales. Por ejemplo, cómo afecta el uso de un procesador de cuatro núcleos lógicos como un Core i5-6400 frente a un ocho núcleos lógicos como el Core i7-6700K.

Aun así, el equipo principal de pruebas utilizado para realizar todas las mediciones lo tenéis a continuación, utilizando los ventiladores de serie de la caja Zalman Z9 Neo. Algo ruidosos para mi gusto, pero que cumplen a la perfección su labor de refrigeración.

Pruebas de rendimiento

Las pruebas de rendimiento de las nuevas tarjetas gráficas suelen centrarse en comprobar su potencia con respecto a otros modelos. Aunque ese tipo de pruebas también las encontraréis a continuación, me ha parecido más interesante analizar lo que sucede al utilizar la GTX 1080 con una serie de procesadores para ver qué tipo de limitación imponen al rendimiento de la tarjeta.

Puesto que es una tarjeta gráfica para jugar extremadamente potente, las pruebas que veréis a continuación también se han realizado a las resoluciones de 1080p, 1440p y 4K UHD. En algunos casos también he podido probar qué limitación impone funcionar con memoria a DDR4 a 2133 y 3000 MHz, y en general la diferencia es mínima, con la excepción de Ashes of the Singularity. Solo afecta el cambio al uso de múltiples GPU en un mismo sistema.

Como norma general, las pruebas se han realizado teniendo solo activo el antiescalonamiento FXAA, desabilitando características específicas de gráficas como HBAO+ o PureHair, y poniendo todas las opciones a los valores máximos posibles. En este caso me interesa más comprobar la potencia en bruto en juegos de las tarjetas gráficas que las diferencias entre las arquitecturas de AMD y Nvidia.

Rise of the Tomb Raider

Este juego de Microsoft Studio es bastante exigente en cuanto a procesador, aunque sobre todo si se quiere jugar con las DirectX 11.

Comparativa por procesador

Un ejemplo curioso es que al usar la GTX 1080 con DX11 y un Core i3-6100, solo llega a los 35 FPS, mientras que al activar las DX12 pasa a los 102 FPS. Es más que probable que haya algún tipo de problema con los controladores y el equipo, pero no he sido capaz de identificarlo. Las DirectX 12 tienen la ventaja de descargar de trabajo a los procesadores, y este es el máximo ejemplo de ello.

| Rise of the Tomb Raider, 1080p, DX11 y DX12, en FPS | ||

|---|---|---|

| Core i7-6700K | 141.6 140.3 | |

| Core i5-6400 | 134.37 139.91 | |

| Core i7-6700 | 134.2 139.5 | |

| Core i7-860 | 85.15 98.84 | |

| Core i3-6100 | 35.47 98.84 | |

Comparativa de GPU

| Rise of the Tomb Raider, 1080p, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 151 154.2 | |

| GTX 1080 | 141.6 140.3 | |

| GTX 980 Ti | 109.3 112.1 | |

| GTX 980 | 82 79.7 | |

| R9 Fury X | 78 75.2 | |

| GTX 970 | 70.9 58.1 | |

| R9 390 | 64.5 63.2 | |

| GTX 960 | 32.1 33 | |

| Rise of the Tomb Raider, 1440p, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 108 105.5 | |

| GTX 1080 | 98.1 96.3 | |

| GTX 980 Ti | 70.2 67.1 | |

| GTX 980 | 57.2 51.9 | |

| R9 Fury X | 55.4 52.6 | |

| R9 390 | 47.6 45.5 | |

| GTX 970 | 47.5 39.6 | |

| GTX 960 | 23.8 13.8 | |

| Rise of the Tomb Raider, 4K UHD, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 58.1 55.7 | |

| GTX 1080 | 51.5 49.9 | |

| GTX 980 Ti | 38.1 36.1 | |

| R9 Fury X | 29.9 28.2 | |

| GTX 980 | 28.7 28 | |

| R9 390 | 26.6 25.2 | |

| GTX 970 | 24.4 21.6 | |

| GTX 960 | 10.8 5.1 | |

Ashes of the Singularity

Ashes of the Singularity es más una prueba de rendimiento que un juego, y hay que tomarlo como tal. Aun así resulta interesante probarlo debido a que es el más avanzado en cuanto a aprovechar las posibilidad de las DirectX 12 se refiere.

Los resultados interesantes sobre los procesadores es que el número de núcleos importa, y en el caso de un doble núcleos físicos (cuatro núcleos lógicos) como es el i3-6100 no alcanza a sacarle ni la mitad del rendimiento a la GTX 1080.

Comparativa por procesador

A diferencia que en otros juegos, en Ashes of the Singularity el utilizar memoria de mayor velocidad tiene una ventaja directa para el rendimiento del equipo que se aleja de los habituales 1 a 3 FPS de más al pasar de 2133 a 3000 MHz. Este juego es una prueba de rendimiento que intenta exprimir al máximo el hardware del equipo, y por tanto saca provecho de las mejoras en velocidad de la memoria.

| Ashes of the Singularity, 1080p, High, en FPS | ||

|---|---|---|

| i7-6700K@3000 | 74.4 86 | |

| i7-6700K@2133 | 68.2 78.2 | |

| i7-6700@2133 | 60.77 75.9 | |

| i5-6400@2133 | 40.2 46.3 | |

| i7-860@1333 | 35.8 45.8 | |

| i3-6100@1600 | 32.5 35.2 | |

Comparativa de GPU

| Ashes of the Singularity, 1080p, High, FPS | ||

|---|---|---|

| GTX 1080 (OC) | 74.9 89.2 | |

| GTX 1080@3000 | 74.4 86 | |

| GTX 1080@2133 | 68.2 78.2 | |

| GTX 980 Ti | 67.2 70.7 | |

| GTX 980 | 55.3 52.5 | |

| GTX 970 | 51.3 48.3 | |

| R9 Fury X | 50.4 74 | |

| R9 390 | 48.6 59.4 | |

| GTX 960 | 35.4 32.2 | |

| Ashes of the Singularity, 1440p, High, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 73.3 85 | |

| GTX 1080 | 72.9 78.6 | |

| GTX 980 Ti | 59.9 59.7 | |

| GTX 980 | 50.1 49.6 | |

| R9 Fury X | 47.9 70.3 | |

| R9 390 | 45.2 51.6 | |

| GTX 970 | 44.1 41 | |

| GTX 960 | 28.3 26.7 | |

| Ashes of the Singularity, 4K UHD, High, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 66.8 70.6 | |

| GTX 1080@3000 | 62.2 62.9 | |

| R9 Fury X | 48.2 55.8 | |

| GTX 980 Ti | 42.6 42.5 | |

| R9 390 | 37.3 40.1 | |

| GTX 980 | 37.1 35.8 | |

| GTX 970 | 32.7 30.8 | |

| GTX 960 | 21.2 19.8 | |

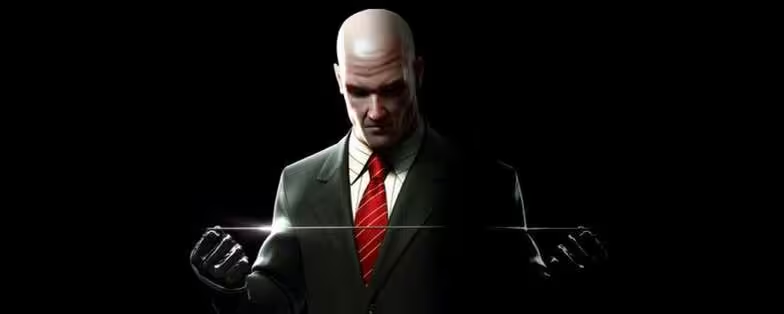

Hitman

Hitman es un título bastante intensivo de GPU y CPU.

Comparativa por procesador

| Hitman, 1080p, DX11 y DX12, en FPS | ||

|---|---|---|

| Core i7-6700K | 104.3 113.2 | |

| Core i7-6700 | 93.5 100.1 | |

| Core i7-860 | 63.3 68.9 | |

| Core i5-6400 | 61.4 62.5 | |

| Core i3-6100 | 45.4 47.5 | |

Comparativa de GPU

| Hitman, 1080p, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 115 121.7 | |

| GTX 1080 | 104.3 113 | |

| R9 Fury X | 88.7 90.2 | |

| GTX 980 Ti | 80.3 79.2 | |

| R9 390 | 71.4 73.2 | |

| GTX 980 | 65.2 62.7 | |

| GTX 970 | 56.1 48.6 | |

| GTX 960 | 34.8 34.6 | |

| Hitman, 1440p, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 92.8 92.7 | |

| GTX 1080 | 81.5 78.5 | |

| R9 Fury X | 67.5 68.5 | |

| GTX 980 Ti | 57.8 57.5 | |

| R9 390 | 52.5 55 | |

| GTX 980 | 46.1 46.1 | |

| GTX 970 | 40.3 33 | |

| GTX 960 | 27.2 26.4 | |

| Hitman, 4K UHD, DX11 y DX12, en FPS | ||

|---|---|---|

| GTX 1080 (OC) | 55.4 54.2 | |

| GTX 1080 | 47.9 47.3 | |

| R9 Fury X | 44 44.5 | |

| GTX 980 Ti | 35.2 34.3 | |

| R9 390 | 33.1 34.1 | |

| GTX 980 | 27 26 | |

| GTX 970 | 21.8 17.2 | |

| GTX 960 | 10.2 9.9 | |

Grand Theft Auto V

Uno de los títulos más jugados actualmente sigue siendo GTA V gracias a su modo online. Rockstar está haciendo una gran labor a la hora de añadir continuamente nuevo contenido al juego, y eso se ve recompensado por la comunidad de jugones.

Comparativa por procesador

| Grand Theft Auto V, 1080p, en FPS | ||

|---|---|---|

| Core i7-6700K | 141 | |

| Core i7-6700 | 136 | |

| Core i5-6400 | 119 | |

| Core i7-860 | 95 | |

| Core i3-6100 | 84 | |

Comparativa de GPU

| Grand Theft Auto V, 1080p, en FPS | ||

|---|---|---|

| GTX 1080 | 141 100 48 | |

| GTX 980 Ti | 101.2 78 34.3 | |

| R9 Fury X | 87.5 61 31 | |

| GTX 980 | 80.3 58 27.6 | |

| R9 390 | 74.2 52 27 | |

| GTX 970 | 72.7 49 24 | |

| GTX 960 | 48.4 31 17 | |

The Division

| The Division, calidad Superior, sin antiescalonamiento | ||

|---|---|---|

| GTX 1080 (OC) | 104.9 77.2 44.3 | |

| GTX 1080 | 95.8 67.4 39 | |

| GTX 980 Ti | 80 55.6 31.8 | |

| R9 Fury X | 72.1 53.8 33.3 | |

| GTX 980 | 64 48.9 24.8 | |

| R9 390 | 49.1 38.2 23.9 | |

| GTX 970 | 46.4 36 19.7 | |

| GTX 960 | 34.8 24.3 11.1 | |

The Witcher 3

| The Witcher 3, Ultra, sin Nvidia HairWorks | ||

|---|---|---|

| GTX 1080 (OC) | 107 82 49 | |

| GTX 1080 | 95 70 39 | |

| GTX 980 Ti | 73 53 30 | |

| R9 Fury X | 62 49 29 | |

| GTX 980 | 58 42 22 | |

| R9 390 | 53 38 22 | |

| GTX 970 | 52 38 20 | |

| GTX 960 | 28 0 0 | |

Temperaturas, ruido y overclocking

El sistema de refrigeración por cámara de vapor de Nvidia, utilizado en algunas de sus tarjetas de referencia (el modelo con las características mínimas que se puede comprar de cualquier ensamblador), no es el mejor del mercado pero tampoco es malo. En general es bastante bueno haciendo su cometido de refrigerar la GPU, pero es necesario que funcione a temperaturas altas.

La tarjeta funciona poniendo de meta los 82 ºC, y en torno a ello hará funcionar a más o menos revoluciones el ventilador de la tarjeta. Esa temperatura no es ningún problema para la GPU, por lo que no hay que dejarse llevar por la sensación de que es una temperatura alta. En plena carga el ventilador se sitúa en torno a los 2.000 RPM. Se puede establecer un modelo de refrigeración distinto utilizando herramientas como MSI Afterburner, pero en general cumple suficientemente bien su función, incluido al hacer OC. Pero en estos casos, puede llegar a ser una tarjeta algo ruidosa.

Las frecuencias se pueden subir hasta los +170 MHz a la GPU y +400 MHz a la memoria (es un chip algo limitado por el ancho de banda, y cuanto más se suba la memoria mejor) sin tener que tocar voltajes (atendiendo a que dos chips no son nunca iguales y permitirán un overclock distinto), de una manera completamente estable. De esta forma se puede alcanzar los 1974 MHz, con una temperatura en la tarjeta gráfica de 88 ºC, y el ventilador funcionando en torno a las 3.300 RPM. Tocando ligeramente los voltajes se puede llegar a +200 MHz de GPU y +500 MHz de memoria, alcanzando en condiciones de una habitación a 20 o 21 ºC y buena refrigeración los 2.100 MHz de turbo, aunque cuesta mucho conseguirlos.

Como he dicho, puede resultar algo ruidosa, en torno a los 45 dB, pero se puede obtener de un 13 a 15 % más de potencia, aunque dependerá del juego y resolución. Las mediciones de temperatura las he realizado en una habitación con una temperatura ambiente en torno a los 27 ºC.

Conclusión

Nvidia ha dado un paso adelante muy importante con la presentación de la arquitectura Pascal. Se queda prácticamente solo en la gama alta del mercado, esos modelos por encima de los 300 euros orientados a un jugón más exigente. La gama entusiasta por el momento no tiene representante, pero será la GTX 1080 Ti cuando se decida a sacarla. La gama media recibirá la GTX 1060, y puede que no se haga mucho de esperar.

La GTX 1080 es la primera tarjeta que podría usarse para jugar a resolución 4K, aunque en muchos juegos será necesario como mínimo subir frecuencias. En los juegos que empiecen a salir a partir de ahora prácticamente será necesario hacer SLI si se quiere jugar a máxima calidad. Aunque dependiendo del monitor, si es un 4K UHD de 27 pulgadas, suele ser más recomendable jugarlos a 1440p con todo al máximo porque de esta forma se llegará a la cifra mágica (para algunos) de 60 FPS.

La disposición multi-GPU en Pascal está limitada a dos tarjetas gráficas, ya que Nvidia deja en manos de las desarrolladoras crear los perfiles para el uso de tres y cuatro tarjetas gráficas utilizando DirectX 12. Esta decisión perjudica solo a un pequeño grupo de entusiastas. Una de las razones, bastante lógica, es que un procesador como el 6700K no es capaz de manejar tres GTX 1080 en SLI, por lo que el grupo de afectados es incluso menor.

En general la GeForce GTX 1080 Founder Edition es la tarjeta gráfica de una sola GPU más potente que hay ahora mismo para jugones, y algo por encima se sitúa la Radeon Pro Duo de dos GPU. Es una tarjeta gráfica que funciona con unos niveles aceptables de ruido, permite buenas subidas de frecuencias, y tiene una arquitectura mucho más refinada que Maxwell.

![La GTX 1060 sería un 15 % más potente que la RX 480 [act.]](https://static-geektopia.com/storage/t/p/535/53525/64x112/0_geforce_gtx_1060.avif)