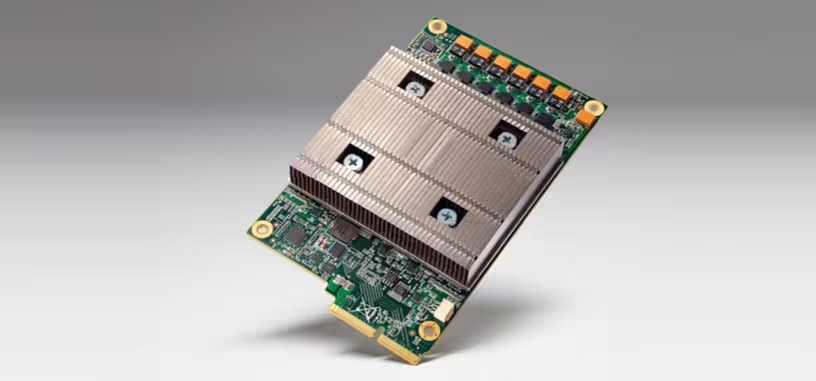

Google cuenta con una enorme plantilla de investigadores, y el fruto de toda la inversión que hace en I+D+i son productos como su nuevo procesador denominado TPU, que son las siglas en inglés de unidad de procesamiento tensorial. Un tensor es una entidad algebraica que es utilizado en la inteligencia artificial por Google para crear redes neuronales con TensorFlow y mejorar las capacidades del aprendizaje automático.

Este sistema, y concretamente el nuevo TPU, fue utilizado en AlphaGo para derrotar a uno de los mejores jugadores de go del mundo. Se trata de una ASIC personalizada, un circuito integrado para aplicaciones específicas y programadas con VHDL por ejemplo, con el cálculo de tensores en mente.

Google lleva usándolos en sus centros de datos desde hace más de un año, y una de las propiedades de las ASIC es que consumen mucho menos energía que un procesador normal. No son reprogramables como las FPGA, otro tipo de circuito integrado orientado a tareas concretas.

Por tanto desde Google han asegurado que estas TPU están siete años por delante de los actuales procesadores para las tareas de computación relacionadas con el aprendizaje profundo, rama de la inteligencia artificial, orientado generalmente a interpretar imágenes y los elementos que la componen, y son parte fundamental de los sistemas de conducción autónoma entre otros. En este caso, Google los convierte en tensores que son procesados por la TPU, obteniendo los cálculos mucho más rápido.

Google no ha proporcionado más detalles, más allá de que funciona con una precisión de 8 bits (el chip GP100 presentado por Nvidia funciona a media precisión de 16 bits), con lo que la potencia computacional es enorme, y la arquitectura de la ASIC mucho más sencilla y con una gran eficiencia. Las TPU están siendo producidas por dos fundiciones distintas de las que no se han dado los nombres, y tiene dos generaciones diferentes en sus servidores.

Vía: PC World, Tech Crunch.