Google lleva más de una década desarrollando sus propios procesadores para sus centros de datos, que son básicamente unas ASIC personalizadas. Las llama unidades de procesamiento tensorial (TPU), y que en la actualidad están diseñadas principalmente para cargar de inteligencia artificial, tanto de entrenamiento como de inferencia. Las dos nuevas TPU que ha mostrado conforman la octava generación de estos procesadores, y terminarán siendo usadas principalmente con Gemini.

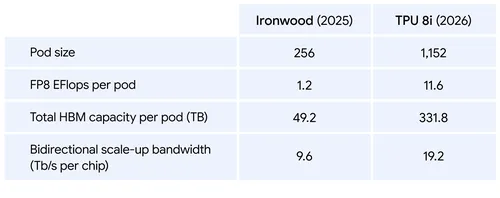

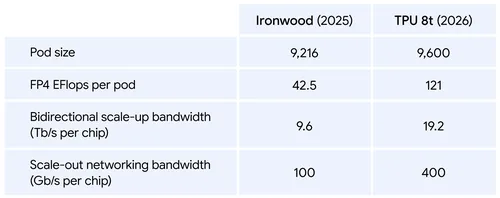

Los dos chips son la TPU 8t y la TPU 8i, que respectivamente son para entrenamiento e inferencia. La primera ofrece el triple de rendimiento frente a un bastidor de la séptima generación, mientras que un superequipo de TPU 8t puede contener hasta 9600 de estos chips y dos petabytes de memoria de alto ancho de banda (HBM) compartidos. Son hasta 121 exa-FLOPS de potencia de cómputo. Tiene un almacenamiento diez veces más rápido, e integra otras mejoras en el flanco del software.

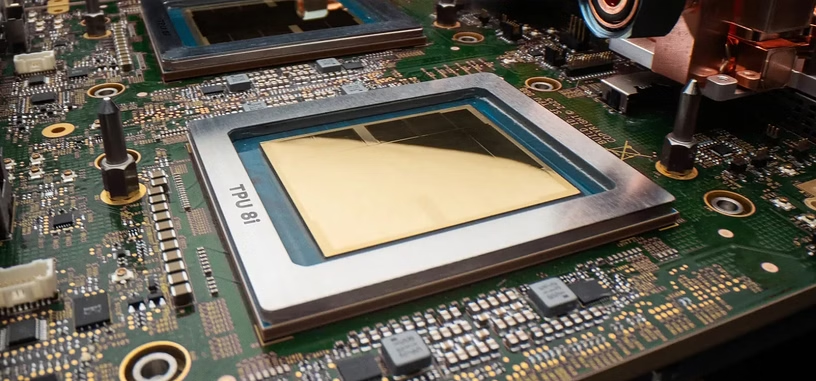

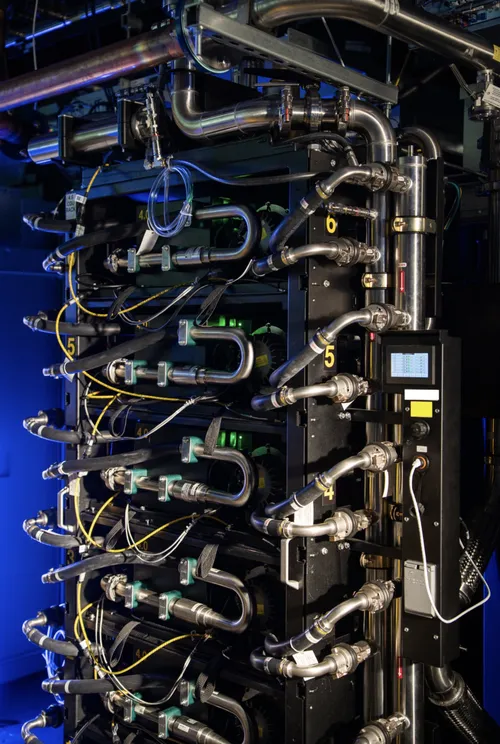

En cuanto a la TPU 8i, tiene acceso a 288 GB de HBM con 384 MB de caché, lo cual es el triple que el equivalente de la generación anterior. Google ha duplicado la capacidad de procesadores por servidor con el paso a usar las CPU de serie Axion de la propia Google. Tienen una arquitectura NUMA pero optimizada, y una interconexión de 192.2 Tb/s. Tanto el 8t como el 8i se usarán con la refrigeración líquida de cuarta generación de la compañía que, bueno, no es la refrigeración líquida como la del sector consumo.

Fuente: Google.