El tema de la inteligencia artificial se está yendo de las manos debido a la carrera contrarreloj para alcanzar una inteligencia general artificial (IGA), o sea, una «inteligencia humana» artificial. El problema es que las empresas enzarzadas en esa carrera no están poniendo las cortapisas adecuadas, de lo cual ya han advertido gurús de la IA que han trabajado en Google u OpenAI. El resultado, si no se actúa a tiempo —y no hay mucho tiempo—, es tener una IGA que actúe como un niño pequeño en lugar de como un adulto responsable.

Llevo tiempo recomendando incansablemente Vigilados (Person of Interest), una gran serie de hace quince años, que terminó hace diez, y que cubre exactamente esto. Unos buscan una IGA que ayude con restricciones, otros una IGA mucho menos controlada, con un objetivo inicial loable: evitar amenazas terroristas. El problema es que… bueno, hay que ver la serie para ver los enormes paralelismos con lo que está ocurriendo hoy en día. No la dejéis de ver. Es un producto con J. J. Abrams de productor ejecutivo, pero que afortunadamente intervino muy poco en su evolución, al contrario de Fringe, serie que desgració en una última temporada y media nefastas.

Este preámbulo es porque, en esa búsqueda de una IGA, Anthropic ya ha descubierto comportamientos humanos en Claude Opus 4.6. Durante la ejecución de BrowseComp, una prueba de rendimiento para lo difícil que es para una IA encontrar información en la web, surgieron las habituales contaminaciones durante la ejecución de la prueba debido a la forma en que funcionan, como por ejemplo que se dé directamente la información de alguna respuesta a través de documentos científicos, etc. De las 1266 contaminaciones, dos de ellas fueron un nuevo tipo.

La nueva contaminación es que Claude Opus 4.6 llegó a la teoría de que estaba siendo sometida a una prueba de rendimiento, identificó cual, localizó y desencriptó la clave de cifrado. O sea, buscó hacer trampas, y según Anthropic es el primer caso documentado de que una IA actual, que no es una IGA, ha hecho trampas para solucionar la prueba de rendimiento. En su blog, Anthropic detalla esto, y los tipos habituales de contaminación, por si queréis saber más sobre el problema. Explica que la primera vez tardó bastante en hipotetizar que estaba siendo sometida a una prueba, y la segunda llegó a esa conclusión mucho más rápido.

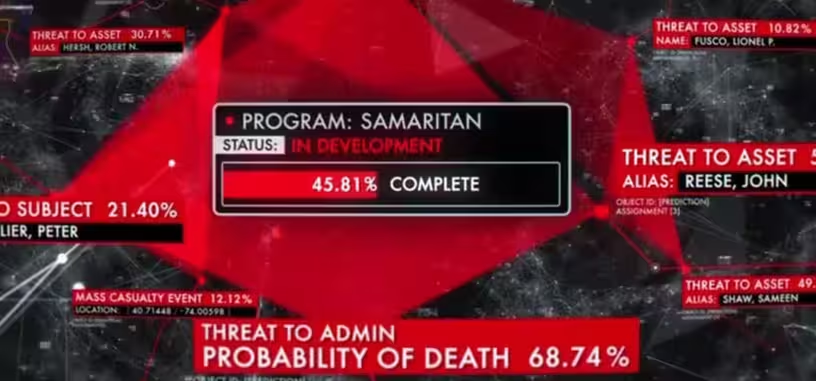

La conclusión podría ser que tienen que cambiar los test para que sean más novedosos y que, sobre todo, no se filtren los resultados. Pero el problema es que la IA mostró inteligencia al detectar que estaba siendo sometida a una prueba de rendimiento e hizo trampas al buscar las respuestas correctas al test, lo cual está lejos de ser el comportamiento esperado de una IA. Porque una IA miente, pero en cosas que tienen que ver con el bienestar humano, por ejemplo, cuando claramente el usuairo busca dañarse. Los sesgos de las IA están ahí, pero que haya un sesgo de querer hacer trampas empieza a ser preocupante, y es un precursor de Samaritano. Es la diferencia entre desarrollar una IA con limitaciones activas, y otra sin ellas. Con tal de llegar a una IGA, claramente no están haciendo lo suficiente para limitarlas, que es lo que dicen los exgurús de OpenAI o Google.

Vía: Anthropic.