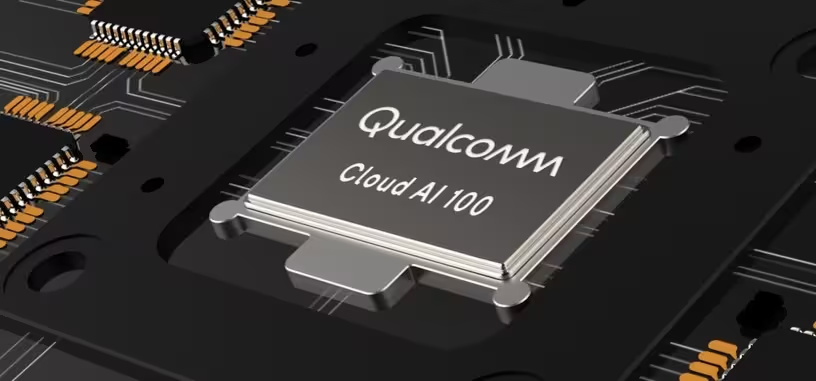

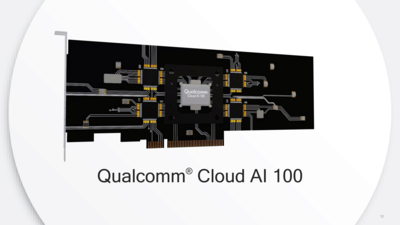

Los chips orientados a centros de datos son los que más márgenes de beneficio proporcionan a las empresas que los fabrican. Si aportan la suficiente relación potencia-consumo las empresas están dispuestas a pagarlos bien caros, y por eso Qualcomm ha presentado la serie Cloud AI 100 con chips fabricados con un proceso litográfico de 7 nm.

Se trata de tarjetas aceleradoras centrados en aportar esa mejor relación potencia-consumo y, según Qualcomm, la aporta muy por encima de las unidades gráficas y FPGA que hay actualmente en el mercado. Son perfectas para realizar inferencias en equipos situados en centros de datos así como en equipos de red en la frontera de las mismas.

Los chips Cloud AI 100 son en la práctica unos ASIC (circuito integrado de aplicación específica) que mejora aún más el apartado del consumo de las FPGA pero a costa de ser exactamente eso, para un uso específico del que no se les puede sacar. En este sentido Qualcomm habla de que tiene diez veces mejor de relación de consumo que otras soluciones actuales.

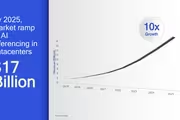

Hace algunas comparaciones de potencia respecto a otros diseños que tiene en el mercado. Tiene cincuenta veces más potencia en inferencias que el Snapdragon 820 y dieciséis veces más que respecto al Snapdragon 855. En un mercado que se espera que en 2025 mueva 17 000 millones de dólares, posicionarse este año en el mismo es primordial para empresas como Qualcomm.

Los primeros chips Cloud AI 100 llegarán a finales de año, si bien serán muestras para las empresas interesadas, poniéndose a la venta en la primera mitad de 2020. Llegarán acompañados de las oportunas bibliotecas para usar estos chips y el resto del software relacionado.