Nvidia introdujo ayer por primera vez en sociedad gran parte de la arquitectura Pascal. Se centró en el sector de la computación de alto rendimiento (HPC), y la primera tarjeta gráfica Pascal se basa en el chip GP100, orientada a la computación. Pero a su vez anunció la llegada en junio de Nvidia DGX-1, un servidor ideado para el aprendizaje profundo, una de las ramas más populares de la inteligencia artificial.

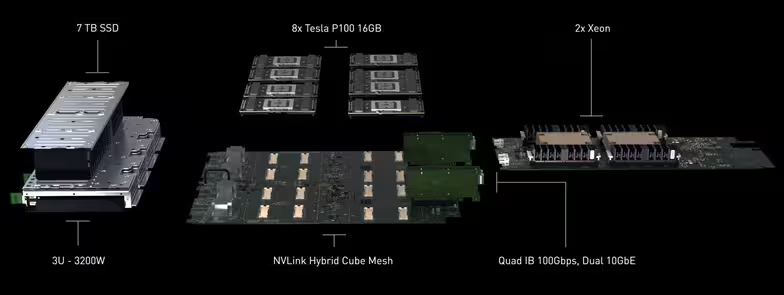

Este servidor incluye ocho Tesla P100, además de dos procesadores Xeon E5-2698 v3 de 16 núcleos, 512 GB de memoria DDR4-2133, cuatro SSD Samsung PM863 de 2 TB en RAID 0, dos conexiones 10 Gigabit Ethernet y 3.200 W de alimentación. Las tarjetas se conectan a las placa mediante un conector mezzanine, y la caja tiene formato de servidores 3U. El precio de este conjunto de hardware es de 129.000 dólares.

Cada Tesla proporciona en torno a 21,2 TFLOPS de procesamiento de operaciones en media precisión, que suelen ser las necesarias para aprendizaje profundo. Esta rama de la inteligencia artificial es necesaria para el reconocimiento de objetos en imágenes, que a empresas como Nvidia le vienen bien para los sistemas de conducción autónoma.

Las ocho tarjetas Tesla P100 están unidas mediante enlaces NVLink. Cada enlace es de 20 GB/s de subida y 20 GB/s de bajada, y se pueden agregar cuatro enlaces para un total de 160 GB/s bidireccionales. El objetivo es favorecer el movimiento de información entre las tarjetas unido con memoria HBM2, eliminando la habitual limitación del ancho de banda de memoria.

Vía: AnandTech.